Un utilizzo critico delle tecnologie AI riguarda l’applicazione nel contesto dei conflitti armati e delle guerre. Il tema è delicato, sia per il potenziale impatto sui conflitti, sia per le questioni etiche connesse all’utilizzo delle soluzioni in questione. Le armi autonome, così come vengono chiamate, hanno infatti un’autonomia variabile per quanto riguarda la selezione dei target da colpire e l’esecuzione delle operazioni stesse. Nel loro utilizzo vengono coinvolti i temi di co-decisione uomo-macchina, il training su cui vengono tarati gli algoritmi delle macchine e il loro grado di autonomia.

Nel recente caso del conflitto Israele-Palestina, forse per la prima volta, un Paese democratico (Israele) utilizza alcuni software di AI (come “Lavender” e “Gospel”) per identificare, sistematicamente e in chiave predittiva, potenziali minacce terroristiche (luoghi e persone) che possono essere neutralizzate o eliminate. Nel recente conflitto, sembra che, tramite questi software, siano state individuate più di 37.000 potenziali persone legate a Hamas, affiliate cioè all’organizzazione terroristica palestinese, per la maggior parte di basso livello operativo. Quando la minaccia sospetta viene colpita, è associata spesso a maggiori possibilità di effetti collaterali sulla popolazione civile, perché l’obiettivo viene colpito con materiale bellico “standard” e non con missili sofisticati e più costosi, riservati invece ai vertici dell’organizzazione.

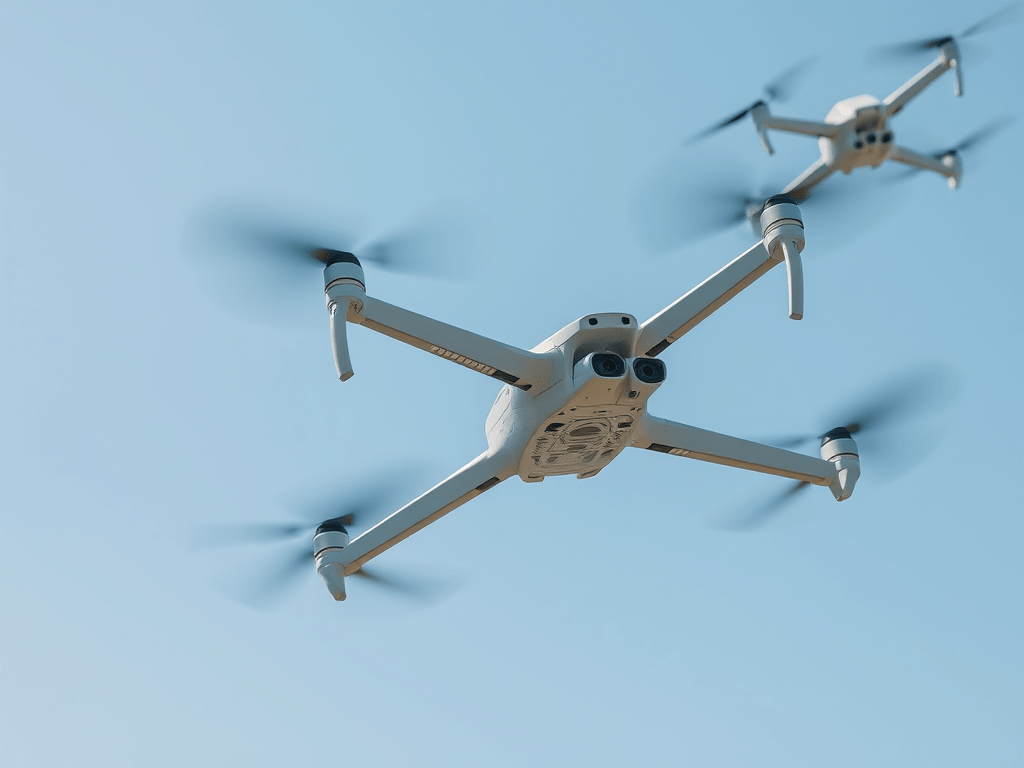

I dati per rendere “intelligenti” questi sistemi di analisi automatica vengono raccolti da diverse piattaforme fisiche, come satelliti, telecamere di sorveglianza, ma anche dai social network e da risorse online. Il sistema AI analizza i dati e identifica, profilando, centinaia di potenziali minacce che vengono poi utilizzati dai decisori militari come bersagli. In un teatro di guerra dinamico e caotico, la percentuale di errore nelle stime di queste analisi è compresa tra il 10 e il 30 percento. I target vengono poi colpiti (da missili, droni) dopo un’approvazione del decisore e le percentuali di errore sono considerate” accettabili” dagli apparati militari: nel caso recente israeliano, l’IDF (l’esercito israeliano) sostiene che l’AI lavori con un tasso di precisione e accuratezza del 90% sui target di bersagli. *

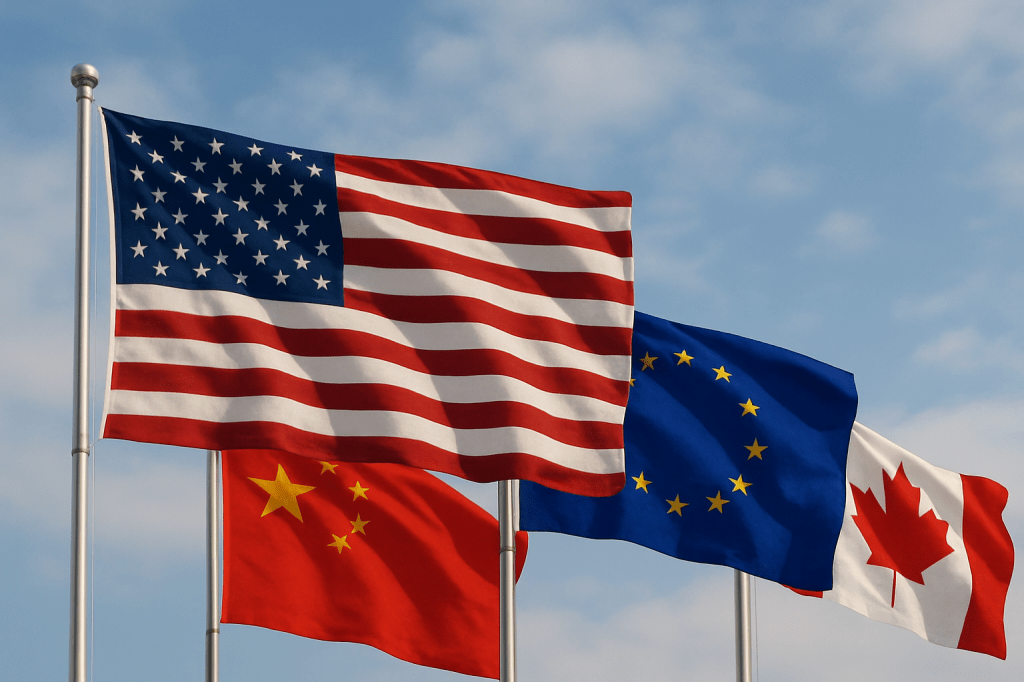

L’ uso di questi sistemi si fonda su alcune decisioni- a priori- degli apparati politico-militari che ne permettono l’utilizzo. Le ragioni ? la velocità esecutiva che serve per garantire una pronta risposta contro le minacce, l’economicità garantita dal loro utilizzo e il minor rischio di utilizzo di risorse umane, soldati. Lo scarso quadro normativo che inquadra tali utilizzi è -ad oggi- contenuto nella sola Convenzione su alcune armi convenzionali (CCW), istituita dalle Nazioni Unite nel 1980, che tratta anche le LAWS (Lethal Autonomous Weapon Systems) e che non è un trattato vincolante. L’utilizzo delle armi potenziate dall’AI ricalca, quindi, un noto schema di applicazione della tecnologia: si testa sul campo prima di un effettivo ragionamento etico-legislativo a monte e, spesso, lo si fa in nome di una rapidità dettata dalla risposta a un’emergenza (nel caso israeliano una risposta rapida, dei vertici politici, alla serie di attentati di Hamas del 7 Ottobre 2023).

Per evidenziare alcune ulteriori criticità di questi sistemi di AI applicati nei contesti di guerra, non è utile solo soffermarsi sul noto problema “tecnico” della difficoltà nello strutturare database (su cui l’AI viene “allenata”) che non abbiano bias razziali, linguistici o classisti che potrebbero, quindi, portare a risposte-stime inadeguate o errate, ma è anche utile accennare al più “impalpabile” presupposto decisionale circa il loro utilizzo. Si afferma di solito infatti che, per mitigare il dilemma etico alla base della responsabilità dell’uso di armi autonome, la decisione nelle situazioni critiche di co-decisione uomo/AI, spetti sempre alla componente umana. In questo schema viene considerato poco o nulla quale sia l’effetto del supporto decisionale offerto dall’AI al decisore che deve poi, effettivamente, maturare una scelta. In che misura, ad esempio, questo input dell’AI influisce sul sistema di giudizio e sulle scelte del decisore ? Uno scenario simile di influenza dell’AI sulle scelte umane avviene, ad esempio, nell’uso dei software e di AI a supporto delle corti di giustizia, per aiutare i giudici a stabilire i gradi di colpevolezza, le entità delle pene e il calcolo della recidiva dei giudicati. Questi strumenti, usati specialmente negli USA, hanno dimostrato-tramite studi di analisi ex-post, di influenzare largamente le scelte dei giudici che vertono in larga parte poi verso l’orientamento offerto dal software. Ciò avviene non solo per ragioni di accuratezza del software ma anche per velocizzare i processi e per deresponsabilizzare il giudice dalla scelta.

Alcune domande potrebbero orientare un dibattito etico più ampio e non ancora articolato adeguatamente: quando un sistema AI viene considerato “giusto”? Ad esempio, per essere “più giusto” di una sua versione precedente, basta che il nuovo modello aumenti il potere predittivo e di accuratezza? Un errore uguale a zero significa giustizia? Definire la giustizia in termini di esattezza esclude i criteri di proporzionalità, distinzione (da caso a caso) e necessità (dell’azione), così come identificati e tutelati dal diritto. E perché, soprattutto, si dà per scontato (almeno presso alcuni apparati di potere politico-militare) che sia accettabile usare questi strumenti a prescindere da un confronto più ampio e maturato tramite un processo politico-democratico, nel seno del diritto internazionale, che valuti la liceità dell’utilizzo di questi strumenti?

Si potrebbe dire che la forza di una scelta umana risieda proprio nella possibilità di essere revocata, messa in discussione…mentre un calcolo esatto, immediato e orientato all’efficienza non gode di un margine di maturazione simile, perché già “allenato” su determinati contesti, pesi e misure. Le regole di base con cui opera un sistema AI devono rimanere valide almeno per il tempo necessario a sostenere l’output generato, poiché non solo definiscono i risultati, ma anche i criteri di correttezza e ammissibilità degli stessi. In un set di regole chiuso, progettato per produrre output certi e probabili, sembra difficile avere un confronto critico e diacronico che monitori l’evoluzione di un fenomeno in una prospettiva storica umana. L’AI, applicata a contesti sensibili come la giustizia o la guerra, appare dunque come uno strumento capace di evolvere se stesso e ottimizzare processi, ma non di contribuire all’evoluzione del pensiero umano su questioni più ampie, come l’etica o la collocazione dell’individuo all’interno della rete di significati con cui deve confrontarsi per prendere decisioni critiche. Una scelta giusta non sembra solo quella esatta, ma anche quella che ammette l’errore di chi decide, e che rende lecita, quindi, una sua revisione attraverso un tempo di maturazione della scelta, che permetta un soppesarla tramite categorie umane di “moralità” e di “sentimento”. Questi requisiti, ridisegnati secondo categorie di giustizia più ampie, sembrano designare solo l’umano come operatore lecito di giustizia.

Lascia un commento